Immagine tratta da Sigma AI

Cause you got something that I had never seen

Spark of Light – Michael Bolton

A spark of light in a dark sky, honey

You take a wish from my wildest dreams and you make it true

That’s what you do

Può incutere in noi un sentimento di sfiducia, o può affascinarci con le straordinarie potenzialità che promette, ma è innegabile che il concetto di Intelligenza Artificiale pervada sempre più ambiti della nostra società e che questo trend meriti la nostra attenzione, la nostra curiosità e sicuramente la nostra preparazione, in quanto, come ogni nuovo strumento, necessita l’acquisizione di nuove abilità per utilizzarlo.

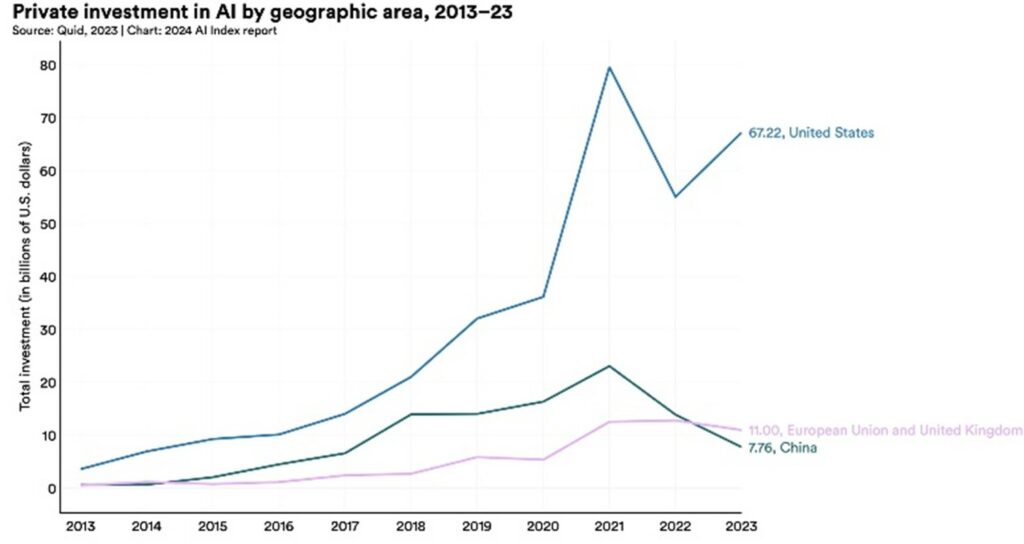

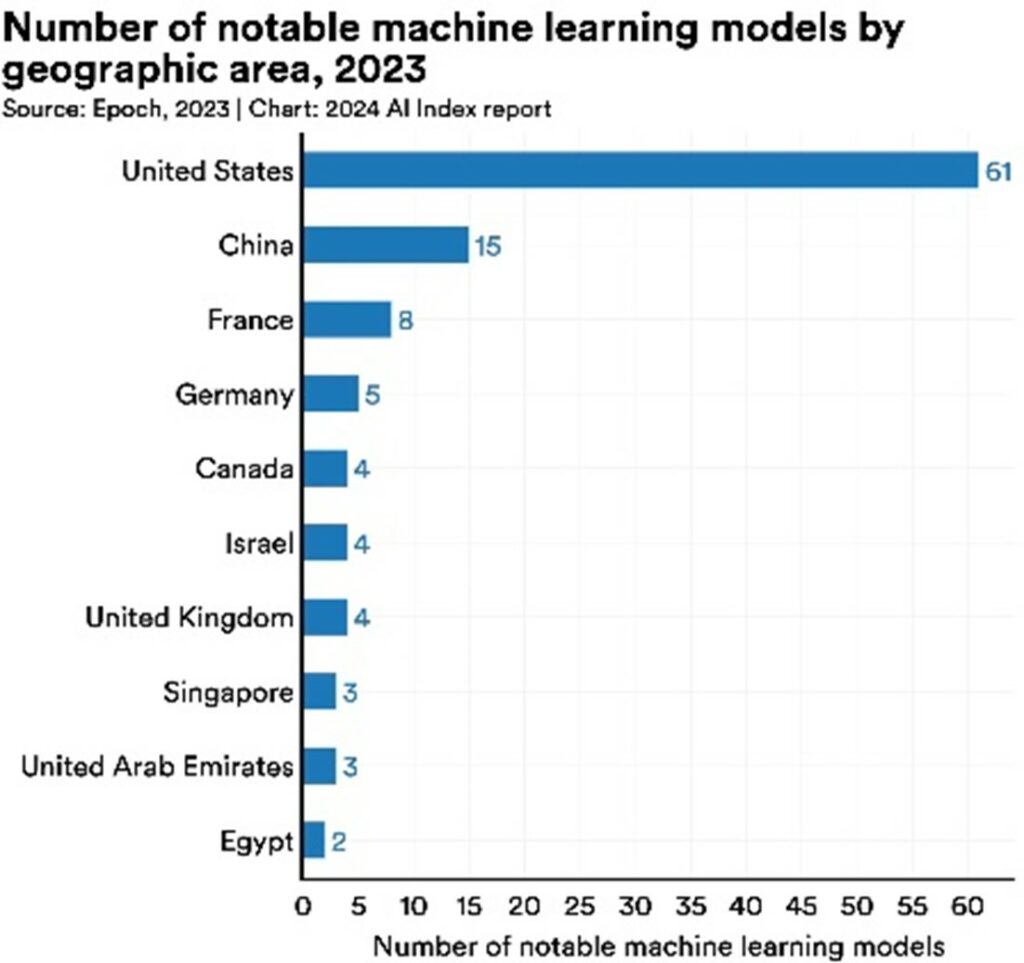

Questa invenzione rivoluzionaria ha già movimentato il mercato degli Stati Uniti in maniera evidente: la potenza a stelle e strisce è infatti leader mondiale indiscusso sia per investimenti privati in Artificial Intelligence (AI) che per numero di modelli importanti.

In cosa consiste però l’Intelligenza Artificiale, e soprattutto dove può essere impiegata? Procediamo con ordine, partendo dalla definizione che ormai abbiamo imparato a conoscere: con AI si intende un tipo di tecnologia che permette a strumenti digitali di completare azioni e compiti tipicamente associate all’intelligenza umana. Vi sono diversi tipi di AI: da forme più deterministiche che seguono delle regole ben definite per rielaborare gli input in output, chiamate AI tradizionali, a quelle che sulla base di calcoli probabilistici, sapendo imparare ed adattarsi, riescono a generare contenuti nuovi e diversi anche sulla base di input identici, chiamate AI generative. Di quest’ultima forma vi sono molti esempi noti, come ChatGPT, Gemini e Llama, prodotti rispettivamente da aziende leader del settore tecnologico quali OpenAI, Microsoft, Google e Meta. Questi strumenti sono incredibilmente utili poiché riescono ad analizzare enormi quantità di dati ed identificare pattern fra gli stessi in pochissimo tempo e con grande precisione; funzionando su base probabilistica però, possono saltuariamente incorrere in errori o “allucinazioni”, e quindi fornire dati fattualmente scorretti o inventati.

Proprio per questi motivi, vi sono grossi dubbi etici sull’implementazione dell’AI, con crescente spinta da parte di privati e governi verso la regolazione di questi strumenti.

Negli States molti settori, quali trasporti, finanza, manifattura, healthcare, educazione e pianificazione urbana, utilizzano già in larga misura strumenti di tal fattura, con stime in grande crescita: Forbes prevede un market size per l’AI nel 2027 di USD 407 bln, tutt’altre cifre rispetto agli USD 85 miliardi previsti nel 2022.[1]

AI e terzo settore

Prendendo atto del fatto che la rotta è stata inequivocabilmente fissata in direzione Intelligenza Artificiale, sorge spontaneo chiedersi come il Settore Non Profit ne sia stato coinvolto, e soprattutto come le organizzazioni senza scopo di lucro debbano relazionarsi con questa controversa realtà. Il Non Profit negli States vanta dimensioni enormi rispetto a quelle del Vecchio Continente, con più di 1,8 milioni di organizzazioni non profit riconosciute dall’IRS[2], e oltre USD 500 bln in donazioni caritatevoli, come riportato da Giving USA nel 2024[3]. Data l’importante struttura del settore, non sorprende come in America le organizzazioni non profit (ONP) stiano già navigando le acque dell’AI. In particolare, questo tipo di strumenti si è dimostrato incredibilmente utile in due campi: quello del fundraising e quello della valutazione di impatto. Nel primo caso, la digitalizzazione aveva già esponenzialmente aumentato l’audience di potenziali donatori di una campagna di raccolta fondi, ma le potenzialità grazie all’AI sono state spinte ancora più in là, rendendo possibile un targeting personalizzato per ogni donatore (un concetto che viene spesso etichettato come “mass personalization”), aumentando l’efficienza delle campagne di raccolta fondi. Prendendo spunto da quanto sta accadendo nel for profit, in cui secondo un recente report di McKinsey le aziende che stanno investendo in AI vedono un incremento del ROI compreso tra il 10% ed il 20%, è lecito aspettarsi anche nel terzo settore un miglioramento operativo, oltre che maggior tempo ed energie preziose da dedicare alla causa per cui l’ente è nato.[4]

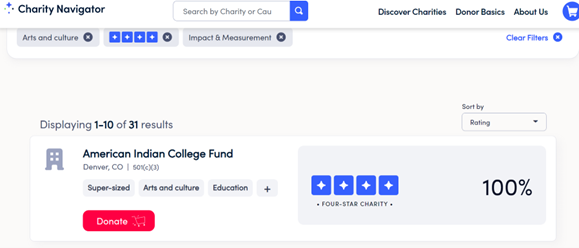

Nel secondo caso, invece, le ONP sono andate a sfruttare la rapidità e precisione dell’AI nell’analizzare enormi quantità di dati, riuscendo a stabilire la qualità dell’impatto sociale delle azioni intraprese. In questo rispetto si vale la pena citare Charity Navigator, una piattaforma digitale che sulla base di diversi parametri associa un punteggio alle ONP che forniscono trasparentemente i loro dati. Così facendo, mettono il donatore nelle condizioni di donare consapevolmente e di creare un effettivo miglioramento nella società.

Esempio di ricerca su Charity Navigator

Ed il Bel Paese?

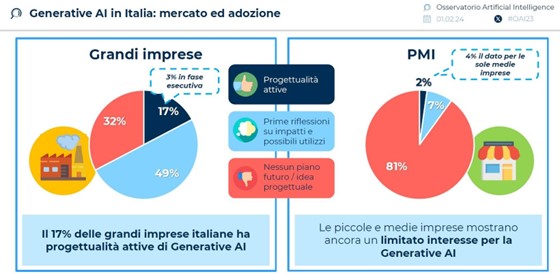

Sulla centralità degli USA in un campo inerente alla sfera digitale quale l’Intelligenza Artificiale vi erano pochi dubbi, ma verso l’Italia quest’ultimi prendono velatamente piede. Come disse lo scrittore e saggista Eduardo Galeano, “il progresso è un viaggio con molti più naufraghi che naviganti”, e l’Italia sta provando a non finire nel primo gruppo, se non altro “salendo sulla barca”: nel 2023 sono stati investiti EUR 750 mln in questa tecnologia, con un tasso di crescita del 265% negli ultimi cinque anni. Va comunque sottolineato che nonostante i grandi investimenti, l’utilizzo italiano di IA è ancora ad uno stadio iniziale. La quasi totalità degli investimenti avviene in grandi aziende, e di queste meno di un quinto ha progettualità attive in Generative AI. Il quadro per le piccole e medie imprese è poi ancora più tetro, in quanto solo il 2% ne dispone.[5]

Venendo quindi a considerare il Terzo Settore, il nostro attore chiave per comprendere l’intrecciarsi fra filantropia e AI, le preoccupazioni aumentano. In Italia il settore del Non Profit appare piuttosto frammentato (“doppio standard” fra enti registrati al RUNTS ed enti che non sono ancora iscritti, allocazione sproporzionata del 5 per mille), nonché sistematicamente disorganizzato. Uno scorcio alquanto differente rispetto agli Stati Uniti. Lo sconcerto aumenta se poi consideriamo come la digitalizzazione ne ha influenzato gli equilibri: pur se la pandemia ne ha accelerato la digitalizzazione, secondo l’Istat nel 2021 una Organizzazione Non Profit su quattro non possedeva ancora una connessione Internet, una su cinque non utilizzava strumenti digitali e solamente il 2% si serviva di altre tecnologie, fra cui strumenti di AI.[6]

In che modo quindi si possa inserire l’AI in questo contesto rimane un quesito aperto. Infatti, gli investimenti necessari per servirsi al meglio di Intelligenza Artificiale sono cospicui, sia da un punto di vista economico che di personale. Concentrarsi subito sull’AI, andando a stanziare grossi fondi per team digitali, software e piattaforme, rischia dunque di indebolire ancor di più il già fragile ecosistema del Non Profit in Italia, senza nemmeno considerare gli altri rischi collegati all’AI stessa. L’Intelligenza Artificiale, infatti, nonostante la sua utilità dirompente e le incredibili opportunità che offre, come tutte le grandi scoperte si porta dietro una serie di grossi rischi.

Alcuni rischi all’orizzonte

Quali sono quindi i rischi che si vedono associati alla sempre maggior diffusione dell’Intelligenza Artificiale? Giuseppe Ugazio, professore a Ginevra che abbiamo già avuto il piacere di intervistare lo scorso anno, ne fornisce una dettagliata categorizzazione[7], sollevando possibili questioni etiche in ben 12 campi:

- Privacy e protezione dati

- Trasparenza ed comprensibilità

- Bias ed errori

- Interazione e connessione umana

- Impatti su posti di lavoro

- Proprietà intellettuale

- Responsabilità

- Inclusività

- Affidabilità

- Disinformazione

- Capacità di comprendere il contesto globale

- Capacità di individuare eventuali atti di corruzione.

Si può forse pensare che il Terzo Settore, nato per tutelare i più bisognosi, riequilibrare le società e far fiorire le comunità, sia immune da questi rischi? Purtroppo no, come può testimoniare la NEDA, ONP che offre sostegno a coloro che soffrono di disturbi alimentari, che nel 2023 ha dovuto sospendere una chatbox AI-powered, “Tessa”, perché stava dando consigli dannosi e deleteri a chi se ne serviva in cerca di aiuto.[8]

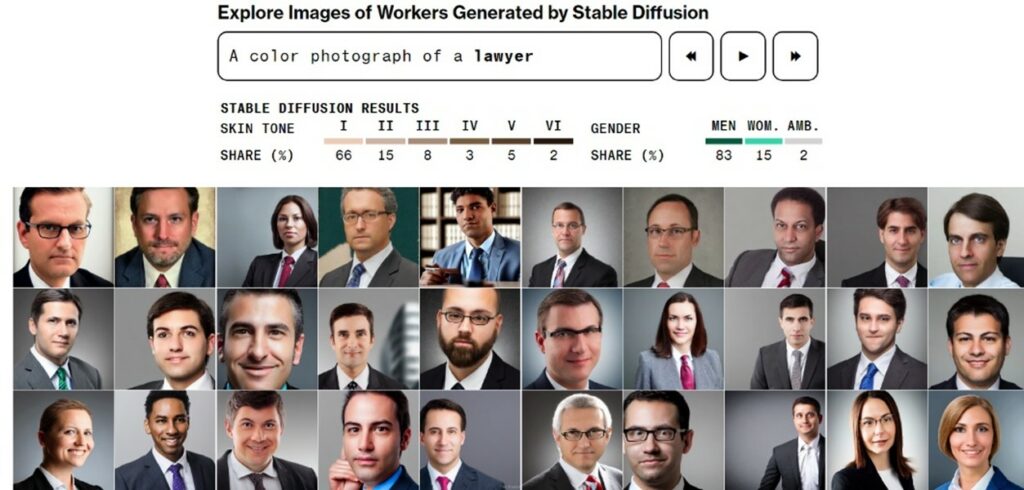

Vi sono poi innumerevoli studi dall’enorme riscontro mediatico, come quello proposto da Bloomberg, che vanno ad indagare uno dei rischi più discussi dalla società civile globale rispetto all’uso di AI, già riscontrato anche nelle categorie del professor Ugazio, ovvero quello del bias cognitivo riscontrato in moltissimi modelli di Intelligenza Artificiale Generativa. Nello slang informatico, a questo proposito, si sente spesso il termine BIBO (Bulls**t in = Bulls**t out), un chiaro e diretto richiamo al fatto che la qualità del dato che serve come input per gli algoritmi è centrale per la qualità dell’output atteso. Il punto sollevato dalle analisi di Bloomberg non fa altro che sottolineare questo, evidenziando come questi strumenti si servono di enormi banche dati fornite dall’uomo, individuandone pattern e ricorrenze che lo aiutano a fornire delle previsioni probabilistiche, replicando e amplificando i problemi della realtà che ci circonda. È quindi vitale il ruolo dell’uomo, il quale deve ponderare e arrovellarsi se sia più importante perseguire una società migliore oppure ottenere un riscontro fotografico della realtà odierna, con tutte le sue imperfezioni e mancanze.

Generative AI Bias, estratto da Bloomberg

Dal punto di vista normativo, l’Europa in ciò si è esposta, tramite l’AI Act, in appoggio a ciò che Ugazio definisce Ethical and Inclusive Artificial Intelligence (EIAI), una visione dell’AI in cui l’efficienza è posta in secondo piano rispetto ad un miglioramento sociale esteso e distribuito. Infatti, questa legge prevede una stringente regolamentazione dell’AI così da limitarne le esternalità negative.

Per fortuna non mancano casi virtuosi di esercizio di Intelligenza Artificiale nell’ambito Non Profit. Due in particolare sono rappresentativi di come questa tecnologia possa adeguatamente servire la filantropia. Il primo viene dal World Food Programme delle Nazioni Unite, una delle più grandi venture umanitarie al mondo, la quale ha efficacemente implementato strumenti di Intelligenza Artificiale per creare la HungerMap Live, una mappa interattiva del mondo che analizza tutti i dati relativi a fame, siccità, conflitti ed altri parametri, per poi geolocalizzarli ed interpretarli fornendo una rappresentazione grafica intuitiva e convincente.

Il secondo valoroso esempio è invece rappresentato da JustGiving, piattaforma online per donazioni benefiche, la quale ha introdotto Story Enhancer, uno strumento che utilizza forme di Intelligenza Artificiale fornite da OpenAI per riscrivere le storie per una campagna di raccolta fondi in maniera più accattivante ed efficace, partendo dalle poche informazioni che gli si fornisce. I risultati dalla sua introduzione sono stati piuttosto promettenti, venendo utilizzato da un quinto degli utenti che si servono di JustGiving, fra i quali oltre il 95% ha dichiarato di essersi sentito molto più sicuro e confidente nello scrivere la propria storia.[9]

Quale lectio si può quindi trarre per il mondo non profit italiano da questa riflessione sul nesso fra filantropia ed Intelligenza Artificiale? Un buon punto di partenza risiede nell’investire in una maggiore solidità strutturale e sistemica, elemento carente nell’odierno Non Profit italiano. Solo dopo aver raggiunto l’obbiettivo di un mercato del Non Profit con dimensioni medie superiori alle odierne, più equo e distribuito, si potrà procedere all’utilizzo di strumenti di Intelligenza Artificiale, tanto utili quanto pericolosi. Dopo tutto non dobbiamo scordarci che la digitalizzazione ha portato sì incredibili vantaggi, ma in maniera sproporzionata a coloro che partivano avvantaggiati, polarizzando ancor di più il tessuto sociale e riaffermando con forza sempre maggiore “il privilegio” del Nord sul Sud Globale.

Nel panorama dell’Intelligenza Artificiale, già ad oggi numerose iniziative e gruppi di lavoro hanno riconosciuto i potenziali rischi associati all’uso di questa tecnologia e stanno proattivamente lavorando per mitigarli. Tra queste, l’IEEE Global Initiative on Ethics of Autonomous and Intelligent Systems si distingue per il suo impegno nello sviluppo di standard etici e linee guida per garantire che l’AI sia utilizzata in modo responsabile e sicuro. Allo stesso modo, l’iniziativa AI for Good, promossa dalle Nazioni Unite, sfrutta l’AI per affrontare sfide globali come la povertà e i cambiamenti climatici, assicurando che l’adozione di queste tecnologie avvenga in maniera etica e trasparente. Questi sforzi riflettono una crescente consapevolezza dei potenziali rischi dell’AI e un impegno concreto a lavorare in anticipo per attenuarli, garantendo che l’AI possa essere una forza positiva per la società, specialmente nel settore non profit.

È quindi chiaro e fondamentale, specialmente per il Terzo Settore, che l’Intelligenza Artificiale abbia un impiego etico, così da apportare un miglioramento effettivo alla società, promuovendo un impatto solido e sostenibile per tutti coloro che popolano le diverse comunità italiane, evitando in principio il rischio di realizzare ciò che Kubrick aveva solo immaginato in “2001: Odissea nello spazio”.

Una riflessione per chiudere questo rapido excursus sui rapporti tra AI e mondo del non profit; in un contesto come quello descritto fino a questo momento in cui tutto ruota attorno al dato e dal dato stesso dipendono gli output che ci si attende dall’utilizzo dell’AI, subordinare ciecamente alla tecnologia ogni tipo di risposta che si sta cercando è un rischio che non ci si può permettere di correre: inserire una dimensione critica nel pensiero, costruirsi una propria idea, vagliare fonti diversi, non accettare la vulgata mainstream in modo automatico, diventa sempre più importante, anzi vitale per lo sviluppo del mondo che lasceremo ai nostri figli. E naturalmente a rischiare di più, come sempre, è proprio chi ha bisogno, perchè la tutela degli interessi di questi soggetti difficilmente è in cima alle priorità dei giganti tecnologici che stanno allenando i propri algoritmi. Può sembrare un ritorno al pensiero critico di matrice Platonica, un sapore old fashion un po’ come la conclusione a cui è giunto un team di ricercatori di importanti università come Oxford e Cambridge nell’analizzare le capacità di ChatGPT nel risolvere problemi matematici, affermando che “If your goal is to use ChatGPT to pass a graduate-level math exam, you would be better off copying from your average peer!”[10]

Approfondimento a cura di Beatrice Marzi e Carlo Sarrocco

Lugano, 14 luglio 2025

Bibliografia:

Bostrom Nick, Superintelligence: Paths, dangers, strategies, Oxford University Press, UK 2014

[1] 24 Top AI Statistics And Trends In 2024 – Forbes

[2] Dati IRS sul Non Profit negli USA

[3] BWF riporta i dati del Report Giving USA 2024

[4] McKinsey sull’impatto dell’intelligenza artificiale in marketing e vendite

[5] Infografica fornita dall’Osservatorio AI e Innovation Post rielabora i dati forniti dallo studio di Osservatorio Artificial Intelligence

[6] Censimento permanente delle istituzioni non profit anno 2021, ISTAT Infografica su ONP e digitalizzazione

[7] Studio sull’AI in Svizzera pubblicato da SwissFoundations

[8] Articolo di WIRED sulla scelta del NEDA di terminare la chatbox “Tessa”

[9] Articolo su JustGiving riguardo Story Enhancer

[10] ChatGPT Math capabilities