Immagine tratta dal film “La grande scommessa”

I think I’m drowning, asphyxiated,

I wanna break this spell that you’ve created

You’re something beautiful, a contradiction

I wanna play the game, I want the friction

Time is running out, Muse

Absolution, 2003

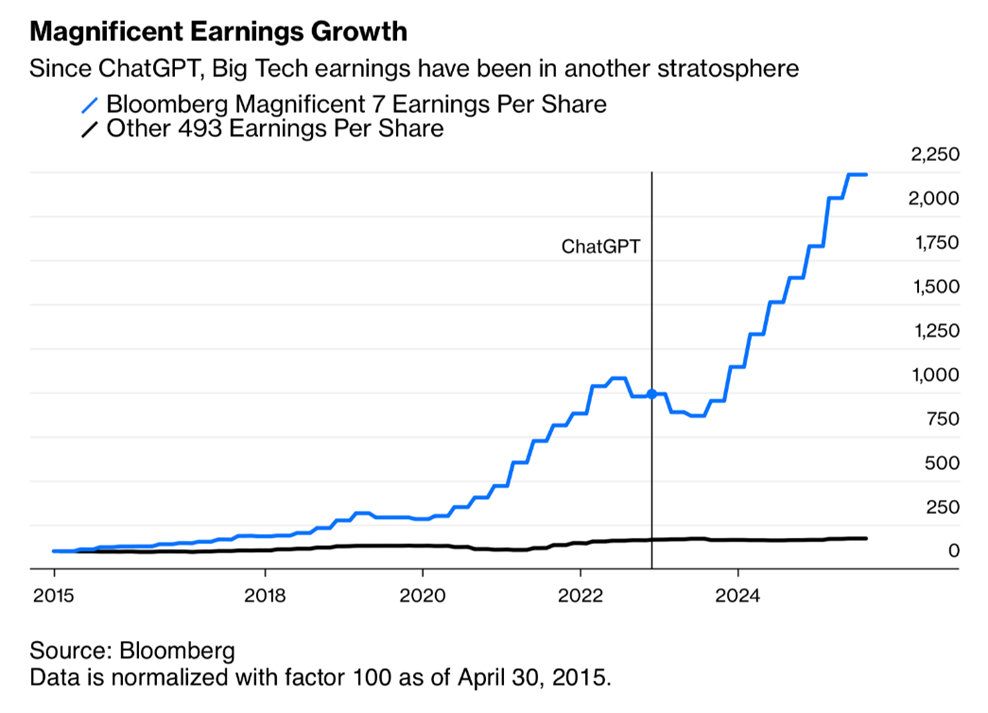

Negli ultimi vent’anni poche trasformazioni tecnologiche hanno ridefinito l’economia globale con la stessa velocità dell’intelligenza artificiale. Dai modelli generativi che scrivono codici e testi, ai sistemi che ottimizzano supply chain, diagnosi mediche e processi industriali, l’IA è passata dall’essere un concetto futuristico e astratto a una componente ormai pervasiva della produttività mondiale. Che la tecnologia avesse un impatto rilevante sulle nostre vite non l’abbiamo scoperto solamente di recente con l’avvento di ChatGPT: negli ultimi decenni ogni rivoluzione tecnologica ha riscritto i confini della produttività e delle abitudini quotidiane. Internet negli anni ’90 ha aperto l’era dell’informazione globale, gli smartphone negli anni 2000 hanno trasformato il modo in cui comunichiamo e lavoriamo, mentre il cloud e la digitalizzazione della filiera produttiva nell’ultimo decennio hanno ridisegnato l’economia delle piattaforme. A ogni salto tecnologico è seguita un’ondata di crescita degli utili delle aziende protagoniste e anche nella situazione attuale questa dinamica si sta ripresentando puntualmente: mentre la crescita degli utili per azione dei restanti 493 titoli dell’S&P 500 procede lentamente dal lancio di ChatGPT, quella dei Magnificent 7 accelera in modo deciso, arrivando di fatto a raddoppiare (grafico qui sotto)

Se da una parte c’è chi ritiene che l’attuale livello delle valutazioni azionarie sia giustificato dalla solidità dei fondamentali, dall’altra non manca chi osserva con preoccupazione la rapidità con cui tali valutazioni si sono impennate. La pendenza del movimento ricorda a molti l’atmosfera della fine anni ’90, quando l’euforia per Internet gonfiò aspettative e capitalizzazioni molto oltre ciò che la tecnologia era pronta a restituire. I paragoni con la bolla dot-com, per quanto imperfetti, emergono dunque con regolarità: anche allora una manciata di società trainava il mercato, la narrativa tecnologica dominava il dibattito e la corsa degli investitori anticipava di anni la maturità dei modelli di business.

A complicare ulteriormente la lettura c’è l’elemento psicologico. Le emozioni degli investitori tendono a oscillare con estrema facilità: periodi di entusiasmo eccessivo si alternano a fasi di pessimismo altrettanto marcato, spesso guidati più da ciò che è appena accaduto che da ciò che conta davvero nel lungo periodo. Questo “bias della recente memoria” amplifica tanto le narrative bullish quanto quelle bearish, rendendo difficile distinguere ciò che è cambiamento strutturale da ciò che è rumore di breve termine, soprattutto quando il sentiment si sposta più rapidamente della capacità dei dati di confermarle o smentirle.

Nella Side View di oggi cerchiamo di fare chiarezza tra le due letture opposte:

- Da un lato, c’è chi rimane prudente. La velocità con cui le valutazioni sono salite, la concentrazione dei profitti in poche società e il ritmo degli investimenti spingono alcuni osservatori a temere che il mercato stia incorporando aspettative troppo elevate rispetto a ciò che l’IA potrà generare nel breve termine.

- Dall’altro lato, c’è chi considera l’IA un megatrend destinato a trasformare interi settori: l’adozione cresce rapidamente, i fondamentali migliorano e le aziende stanno investendo cifre enormi per costruire l’infrastruttura del futuro.

Al lettore, come sempre, il compito di valutare quale narrativa interpreta meglio ciò che sta accadendo: AI Bubble o AI Boom?

AI Bubble

Passo più lungo della gamba? – CAPEX

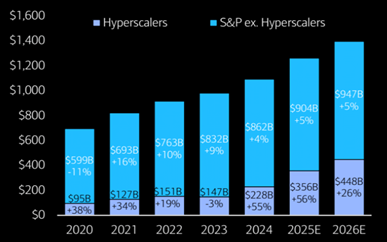

Il nodo centrale del dibattito riguarda la divergenza crescente tra la traiettoria degli investimenti (CAPEX, spese in conto capitale) e quella dei ritorni economici. I dati a destra mostrano un aumento molto rapido del CAPEX degli hyperscaler: si passa da 95 miliardi nel 2020 a 127 miliardi nel 2021, 151 miliardi nel 2022, per poi stabilizzarsi a 147 miliardi nel 2023. Dal 2024 in avanti la curva torna a irripidirsi: 228 miliardi nel 2024, 356 miliardi stimati nel 2025 e fino a 448 miliardi nel 2026, con un incremento del 26% anno su anno nell’ultima proiezione. La spesa per infrastrutture legate all’IA è diventata l’asse portante del ciclo di investimento tecnologico globale, e la sua dimensione pone domande legittime sulla sostenibilità nel medio termine.

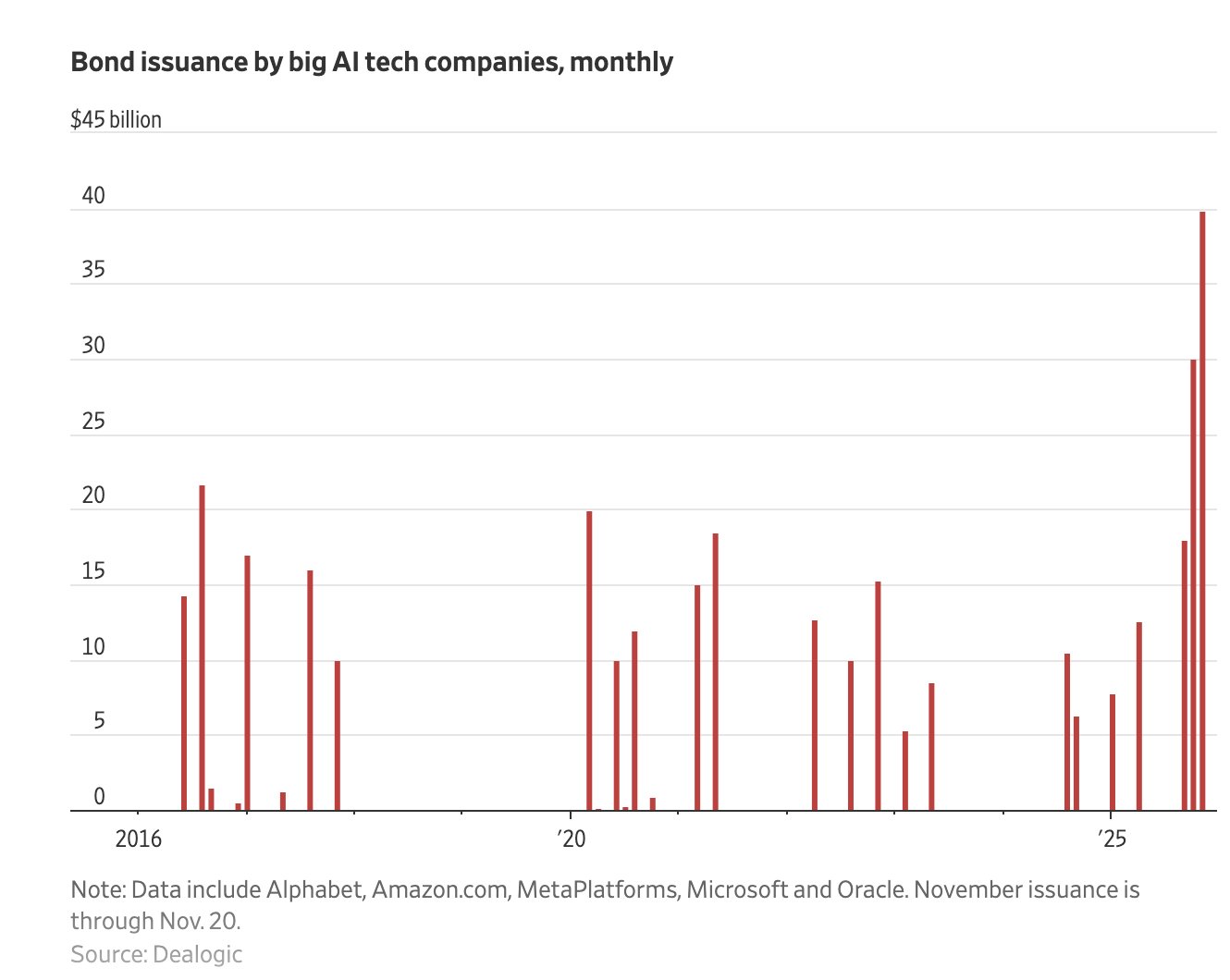

Sul fronte dei flussi di cassa la dinamica è differente. Il cash flow combinato degli ultimi dodici mesi di Amazon, Google, Meta e Microsoft è atteso ridursi da circa 390 a 270 miliardi entro il Q1 2026, un calo del 43%. Si tratta di un movimento che segnala come il ciclo di investimenti in corso stia incidendo in modo rilevante sulla generazione di cassa con gli hyperscaler che stanno facendo crescente ricorso al debito per sostenere l’espansione delle proprie infrastrutture. Negli ultimi tre mesi Google, Amazon, Meta, Microsoft e Oracle hanno emesso circa 88 miliardi di dollari di nuove obbligazioni, più di quanto avessero fatto complessivamente nei tre anni precedenti (66 miliardi). Il grafico mostra in modo evidente questa accelerazione, con un picco vicino ai 40 miliardi di dollari di emissioni questo mese. Un crescente ricorso al debito inevitabilmente richiama l’attenzione dei mercati del credito, sempre sensibili ai cambiamenti nei profili di rischio.

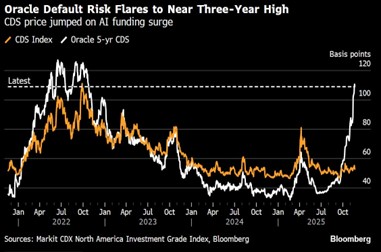

Il caso di Oracle è emblematico: il suo CDS a 5 anni, cioè il costo di assicurarsi contro un’eventuale insolvenza dell’emittente, è tornato su valori che non si vedevano da due anni (grafico a destra), una dinamica che ha portato ad una battuta, provocatoria, ma non del tutto scollegata dal contesto, del Chief Investment Strategist di Bank of America Michael Hartnett: “Sapremo che la Fed tornerà a fare Quantitative Easing quando inizierà a comprare le obbligazioni degli hyperscaler dell’IA”.

Il punto di Burry – Gli utili si separano dalla realtà operativa

A tutto ciò si aggiunge una sfida contabile: la rapidità con cui modelli e hardware evolvono rende sempre più breve il ciclo di vita degli investimenti. Una parte del capitale allocato rischia quindi di richiedere aggiornamenti frequenti, con tempi di ammortamento più brevi del passato. È proprio su questo punto, la necessità di investire in modo crescente per evitare che l’infrastruttura diventi obsoleta troppo rapidamente, che si concentra oggi parte del dibattito. Non è un caso che abbiamo scelto come copertina Michael Burry, il protagonista del film La Grande Scommessa, immortalato mentre analizza i dati che ormai vent’anni fa lo portarono a intuire la fragilità del mercato immobiliare americano. In realtà, Burry mancava dal social X da aprile 2023, e la sua ricomparsa è arrivata in un momento che molti hanno letto come un segnale. Anche perché, nel frattempo, il suo fondo, Scion Capital, aveva rivelato nel proprio filing trimestrale alla SEC, l’autorità statunitense che vigila sui mercati finanziari e richiede ai fondi una rendicontazione periodica delle loro posizioni, posizioni ribassiste tramite derivati su Nvidia e aveva quasi azzerato l’intero portafoglio azionario. Se nei rapporti precedenti il fondo specificava che quegli strumenti potevano servire da copertura per posizioni lunghe non dichiarabili, nell’ultimo quella nota è scomparsa. Il suo messaggio pubblico, poi, è stato semplice quanto eloquente: “A volte vediamo delle bolle… e a volte l’unica mossa vincente è non giocare.” Un riferimento non casuale, accompagnato da un fermo-immagine del film e da un nuovo profilo ribattezzato “Cassandra Unchained”, richiamo alla profetessa destinata a non essere creduta. Il grafico allegato al suo post sintetizza bene il punto sollevato. La tabella mostra come, dal 2020 al 2025, i principali hyperscaler abbiano progressivamente esteso la vita utile stimata delle loro infrastrutture di rete e calcolo: da 3 a 4 anni, fino ad arrivare in alcuni casi a 5 o 6 anni. Un cambiamento con conseguenze contabili significative secondo Burry: allungare la vita utile riduce la quota di ammortamento annuale e, di conseguenza, incrementa gli utili riportati. Secondo le sue stime, la differenza tra la vita economica reale di questi asset, spesso vicina ai 2–3 anni nei cicli IA più avanzati, e la vita contabile adottata porterebbe a una sottostima cumulata degli ammortamenti pari a circa 176 miliardi di dollari tra il 2026 e il 2028. In alcuni casi, l’effetto potrebbe essere rilevante: entro il 2028, Burry calcola una possibile sovrastima degli utili del 26,9% per Oracle e del 20,8% per Meta.

Una parola che evoca la dot.com bubble – Circolarità

“Circularity” è diventata una delle parole più ricorrenti quando si parla dei grandi accordi nell’ecosistema dell’intelligenza artificiale. Alcuni investitori hanno iniziato a tracciare parallelismi tra i “mega deal” di oggi e certi eccessi che caratterizzarono la bolla dot-com ad inizio 2000. In pratica, la circolarità si manifesta quando un’azienda investe in un’altra, spesso a valle della catena tecnologica, e questa utilizza parte dei capitali ricevuti per acquistare prodotti o servizi dall’investitore originario. Nel caso dell’IA, la sequenza più frequente è: chipmaker → hyperscaler → società di IA.

Esempi recenti sono:

- Nvidia–OpenAI–Oracle: Nvidia ha annunciato un impegno fino a 100 miliardi in OpenAI, che a sua volta ha accordi per acquistare milioni di GPU Nvidia, mentre Oracle fornirà a OpenAI fino a 300 miliardi di dollari in capacità computazionale basata proprio su hardware Nvidia.

- AMD–OpenAI: AMD ha offerto warrant che permettono a OpenAI di acquistare fino al 10% della società a un prezzo simbolico, in cambio della prospettiva di forniture future di chip per decine di miliardi.

- CoreWeave–Nvidia–Microsoft–OpenAI: CoreWeave compra chip Nvidia, Nvidia possiede parte di CoreWeave e garantisce di acquistare eventuale capacità cloud invenduta; OpenAI è sia cliente sia azionista di CoreWeave, mentre Microsoft, investitore di OpenAI, è il principale utilizzatore dei data center di CoreWeave.

Si tratta di operazioni perfettamente regolari, che rispondono alla necessità di costruire infrastruttura in tempi molto brevi. Ma è proprio l’intreccio sempre più fitto tra investimenti, forniture e partecipazioni a sollevare interrogativi: quanto della domanda è realmente organica e quanto è sostenuta da capitali che circolano all’interno dello stesso ecosistema?

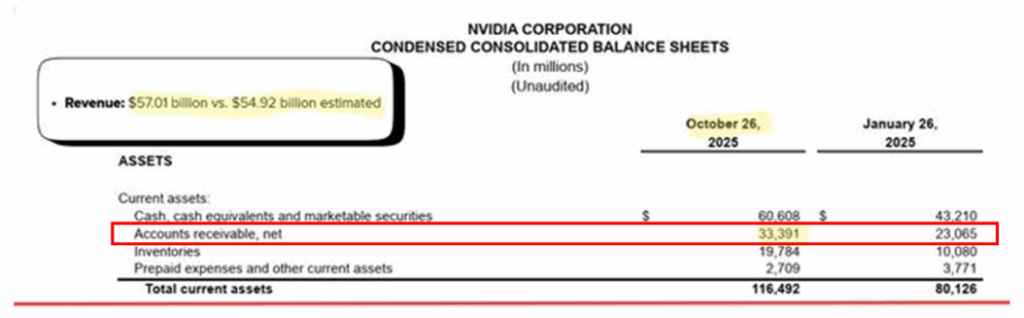

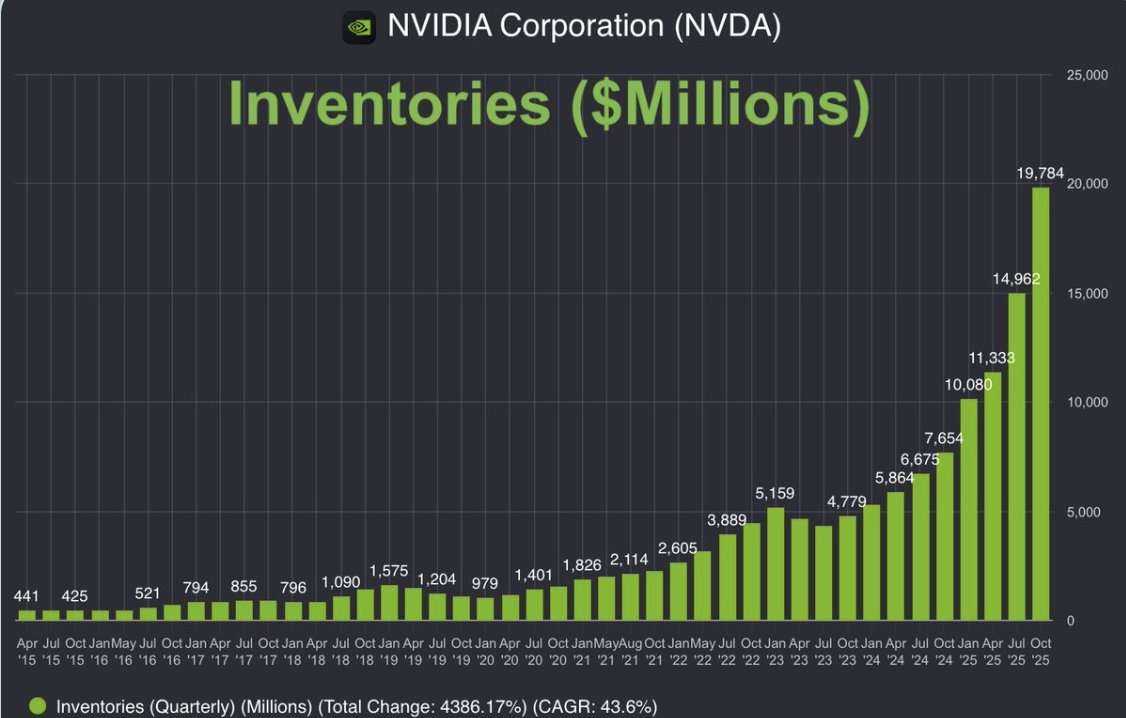

Ad attirare ulteriormente l’occhio degli analisti su questo tema è stata la trimestrale del colosso da ormai 5 trilioni di dollari di capitalizzazione Nvidia. La società guidata da Jensen Huang ha riportato ricavi per 57,0 miliardi di dollari, superando le attese. Due dettagli del bilancio hanno fatto discutere: gli accounts receivable (crediti verso clienti) e le scorte. I primi sono aumentati di circa 6 miliardi di dollari in un solo trimestre, uno dei maggiori incrementi nella storia della società con il divario tra ricavi e incassi effettivi (revenues vs receivables) che ha raggiunto circa 3,5 miliardi, mentre il magazzino è quasi triplicato, passando da circa 8 miliardi a quasi 20 miliardi di dollari. Per alcuni osservatori questo può riflettere un accumulo strategico in vista delle nuove generazioni di chip; per altri indica che il ritmo della domanda effettiva potrebbe iniziare a normalizzarsi dopo la corsa degli ultimi trimestri. C’è poi chi legge in questo fenomeno un ulteriore segnale di un possibile collo di bottiglia a monte: la capacità energetica necessaria ad alimentare i nuovi data center, che in molte aree del mondo cresce più lentamente dell’offerta di hardware.

AI Boom

Le valutazioni azionarie sono giustificate dai fondamentali

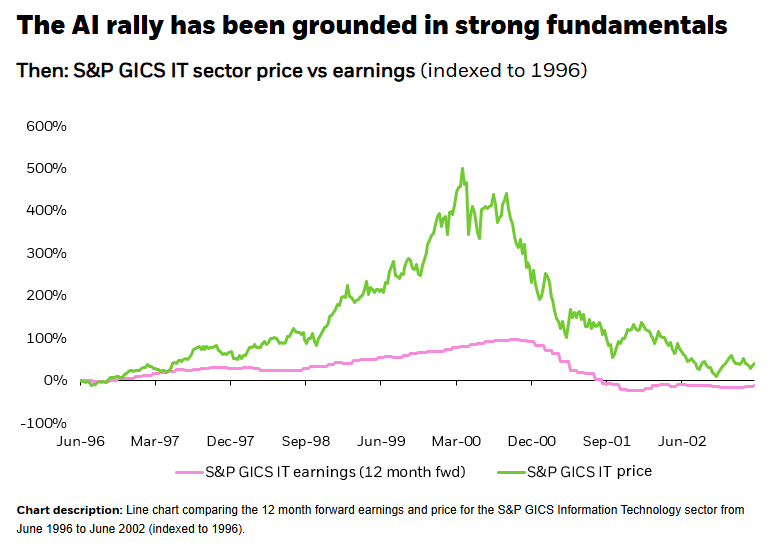

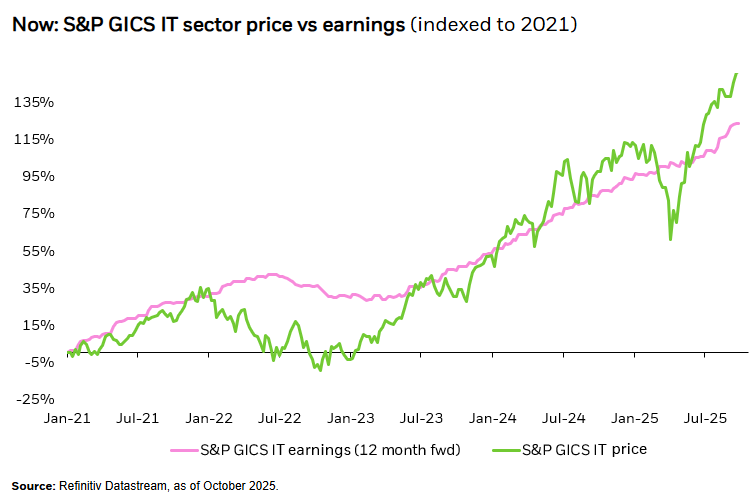

Un primo argomento a sostegno della tesi “non siamo in una bolla” riguarda la distanza strutturale tra l’attuale ciclo dell’IA e la bolla dot-com. All’epoca, la salita dei prezzi correva molto più veloce della crescita degli utili: nella pagina successiva a sinistra il grafico mostra chiaramente come, tra il 1998 e il 2000, le quotazioni del settore IT aumentassero di diverse volte mentre gli utili rimanevano sostanzialmente piatti. Era un rialzo basato su promesse più che su risultati.

Oggi il quadro è differente. Negli ultimi 5 anni, prezzi e utili del settore hanno viaggiato su traiettorie coerenti: la linea verde e quella rosa salgono insieme, segnalando che una parte significativa dell’apprezzamento è sostenuta da una reale espansione dei fondamentali.

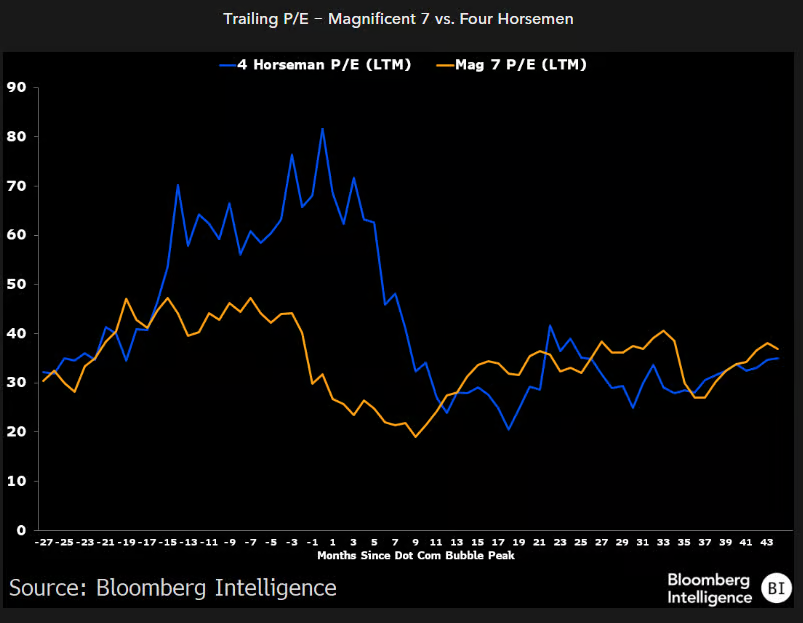

Lo stesso messaggio emerge confrontando i Magnificent 7 con i Four Horsemen della fine degli anni ’90. Alla vigilia della bolla, Cisco, Microsoft, Dell e Intel scambiavano su multipli ben oltre 80 volte gli utili. I Magnificent 7 oggi viaggiano attorno alle 36 volte, livelli certamente elevati ma molto lontani dagli eccessi dell’epoca — e accompagnati da una massa di utili, flussi di cassa e leadership competitiva che allora non esistevano. Un’indicazione chiara che il multiplo dice poco senza considerare la traiettoria degli utili che lo sostiene. La storia della Nifty Fifty degli anni ’60–’70 rafforza questa idea. Quel gruppo di “blue chip stocks” veniva considerato carissimo (circa 42x gli utili), ma il successivo crollo del ’73–’74 fu più il risultato del regime di inflazione e tassi che di un fallimento dei fondamentali. Chi ha comprato ai massimi del 1972 e mantenuto per due decenni ha comunque ottenuto un rendimento superiore al 12% annuo, migliore dell’S&P 500. Ex post, quei multipli non erano folli: gli utili hanno continuato a crescere per decenni, erodendo naturalmente l’apparente “overvaluation”.

La dispersione tra le aziende tuttavia era enorme. Alcune società, Coca-Cola è l’esempio più citato, scambiavano a 46x, ma hanno generato ritorni maggiori del 16% annuo per vent’anni, risultando “economiche” anche a multipli elevati. Altre, come Xerox, con lo stesso P/E iniziale di Coca Cola, hanno invece deluso perché la crescita non ha tenuto il passo. La lezione di quel periodo è che quindi: multipli simili non significano prospettive simili, e il valore sta nella sostenibilità della crescita, non nel prezzo di partenza.

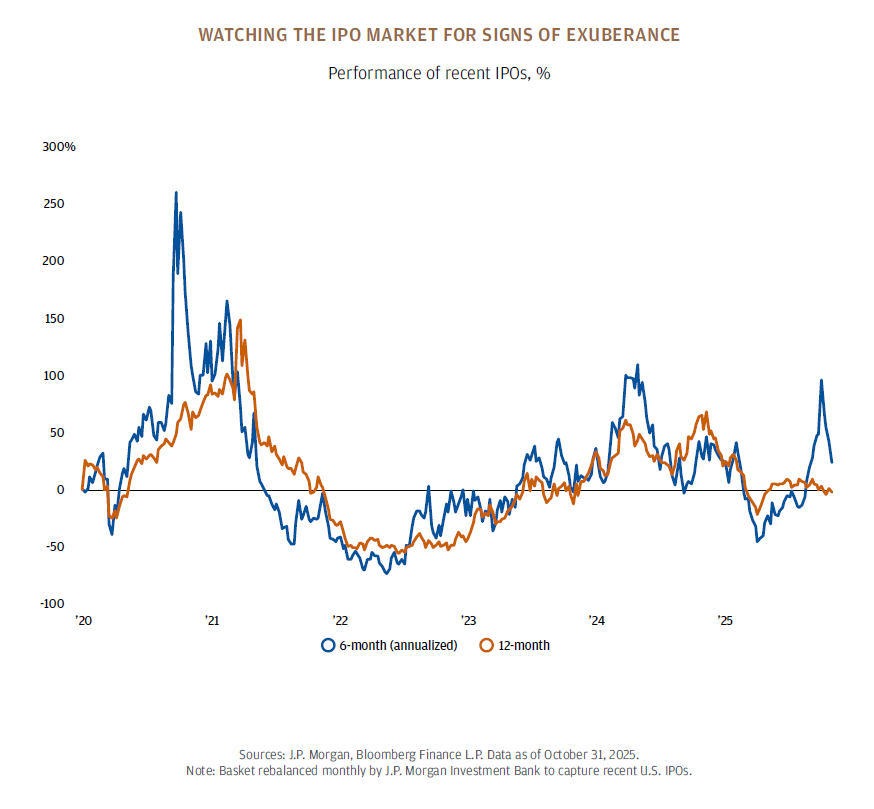

Manca la corsa alle IPO rispetto alla “.com bubble”

Un altro elemento che distingue in modo netto l’attuale ciclo dell’IA dalla bolla dot-com è ciò che non sta accadendo sul mercato delle IPO. Se c’è un tratto che definì la mania del 1999–2000 fu la corsa frenetica a quotare qualunque cosa avesse un “.com” nel nome: secondo uno studio accademico del 2005[1], nei soli due anni del picco arrivarono sul mercato 585 IPO Internet, con un rendimento medio nel primo giorno di contrattazioni di oltre l’80%. Era un mercato in cui bastava una presentazione brillante per raddoppiare di valore in 24 ore, e in cui le IPO Internet superarono di gran lunga quelle delle società tradizionali. Oggi lo scenario è quasi l’esatto opposto. Il grafico di J.P. Morgan mostra come le performance delle IPO recenti oscillino intorno allo zero, senza picchi di euforia né premi di sottoscrizione fuori scala, e il numero di nuove quotazioni tech rimanga ai minimi degli ultimi vent’anni. Non c’è un’ondata di startup senza ricavi che cavalca il sentiment del momento: il motore del mercato sono aziende già ampiamente profittevoli e con modelli di business consolidati. Se la bolla dot-com fu, prima di tutto, una bolla di IPO, il boom dell’IA, almeno finora, non lo è. E questa differenza strutturale è uno dei motivi per cui molti osservatori faticano a sovrapporre i due cicli.

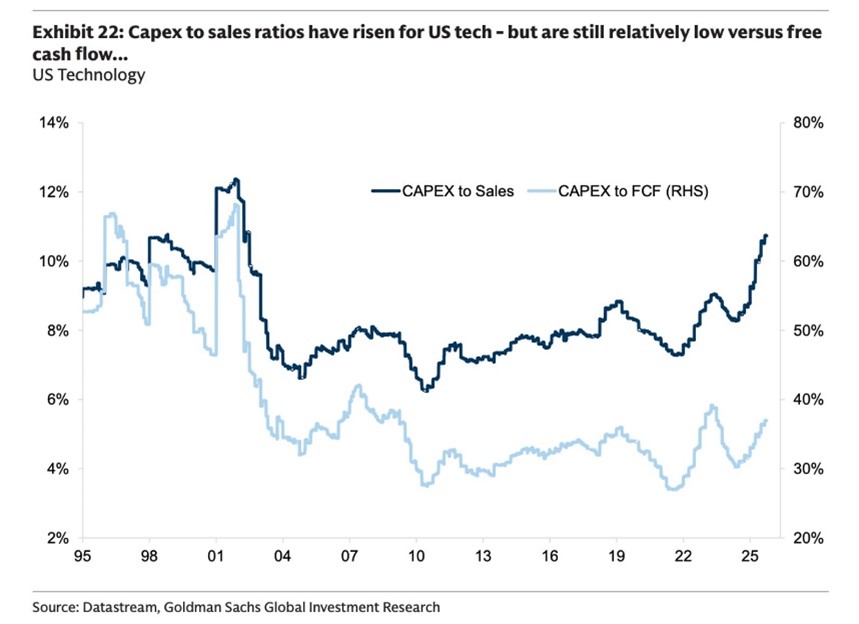

Le aziende oggi usano molto di più la cassa per il CAPEX

Al di là delle metriche di crescita che abbiamo toccato nel punto precedente, un secondo argomento a favore della tesi “AI Boom” riguarda la qualità del finanziamento dell’attuale boom di investimenti. Nonostante la critica sul maggior utilizzo di debito da parte degli hyperscaler,il grafico di Goldman Sachs mostra come il CAPEX del settore tecnologico statunitense abbia raggiunto livelli tra i più alti mai osservati: il rapporto CAPEX-to-Sales è salito all’11%, il valore più elevato dal 2000, con un incremento di circa 4 punti percentuali in tre anni, uno dei più rapidi degli ultimi decenni. La differenza rispetto alla fine degli anni ’90, però, è sostanziale. Allora il ciclo di investimento era sostenuto in larga parte dal debito: il rapporto CAPEX-to-Free Cash Flow si aggirava intorno al 60%, segnalando che una quota molto rilevante della spesa non era coperta dalla generazione interna di cassa. Oggi la situazione è quasi speculare: il rapporto è intorno al 38%, vicino ai minimi dell’ultimo decennio, implicando che la maggior parte del CAPEX viene finanziata con la cassa prodotta.

Per chi non vede una bolla, questo è un punto essenziale: le aziende stanno investendo molto, ma lo stanno facendo con risorse proprie, in condizioni di solidità finanziaria e margini elevati. È un profilo di spesa molto diverso da quello di fine anni ‘90, quando la leva contribuì a gonfiare l’eccesso e a rendere il sistema più vulnerabile.

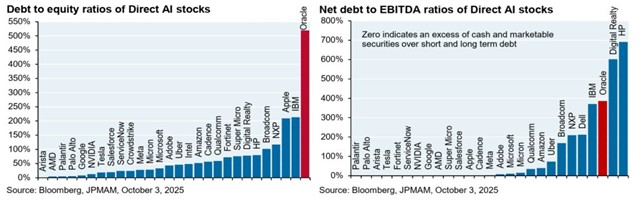

E, quando alcune società mostrano livelli di leva più aggressivi, il mercato sembra aver imparato a riconoscere rapidamente gli eccessi e a prezzarli di conseguenza — come abbiamo visto nel caso di Oracle con l’allargamento dei CDS. Il grafico di J.P. Morgan qui sotto lo evidenzia bene: all’interno dell’universo “direct AI”, la maggior parte delle aziende mantiene livelli di debito relativamente contenuti, mentre i casi più tirati emergono immediatamente, segnalando un sistema in cui la vigilanza del mercato è più rapida e selettiva rispetto ai cicli passati.

La risposta di Nvidia a Burry

Un terzo argomento avanzato da chi non vede una bolla riguarda la natura stessa del ciclo tecnologico, messa in evidenza dalla risposta formale che Nvidia ha inviato agli analisti dopo le critiche mosse da Michael Burry. Nel memo, sette pagine circolate privatamente a Wall Street, la società affronta direttamente le obiezioni, a partire dalla più discussa: la vita utile delle GPU. Mentre Burry sostiene che l’hardware IA abbia un ciclo economico di due-tre anni, Nvidia ricorda che molte GPU, come le A100 lanciate sei anni fa, sono ancora oggi utilizzate a pieno regime, spinte da continui miglioramenti software. Per questo Nvidia sostiene che le vite utili adottate nei bilanci, comprese tra quattro e sei anni, riflettano più fedelmente l’effettivo utilizzo delle sue GPU nei data center. La società respinge poi l’idea di “circular financing” come elemento sistemico, sottolineando che le sue partecipazioni strategiche rappresentano una frazione minima del fatturato e che la maggior parte dei capitali raccolti dalle startup IA proviene da investitori esterni. Sul fronte operativo, Nvidia mette l’accento sulla solidità della generazione di cassa: 23,8 miliardi di operating cash flow e 22,1 miliardi di free cash flow nell’ultimo trimestre, con una conversione vicino al 100% del net income dal 2018.

Quanto al paragone con Cisco nel 1999, Nvidia riconosce di trovarsi al centro di un massiccio ciclo di investimento, proprio come Cisco allora, ma ne sottolinea le differenze:

- un modello “full stack” hardware-software, ossia un’offerta integrata in cui Nvidia non vende solo chip, ma anche tutta la piattaforma software che li rende più efficienti e ne estende la vita utile. Il cuore di questo ecosistema è CUDA (i.e. Compute Unified Device Architecture), l’ambiente di programmazione che permette agli sviluppatori di far girare modelli sempre più complessi sugli stessi chip, anche dopo diversi anni dal loro lancio. È un elemento cruciale: man mano che il software migliora, le GPU già installate continuano a rimanere performanti e quindi economicamente utili più a lungo.

- la domanda che alimenta il ciclo IA non dipende da una singola narrativa, come accadde negli anni ’90 con l’idea che “il traffico Internet raddoppia ogni 100 giorni”, ma da un insieme di segmenti diversi: cloud, inferenza, modelli generativi, automazione di processi, sicurezza, ricerca scientifica.

Per tirare le somme …

Ogni grande trasformazione tecnologica oscilla tra scetticismo e convinzione. In questo equilibrio si inserisce anche la riflessione di Jeff Bezos all’Italian Tech Week di Torino che suggerisce una chiave di lettura più sfumata: non tutte le bolle sono uguali. Secondo il fondatore di Amazon, nei momenti di forte entusiasmo “finanziare idee buone e meno buone è quasi inevitabile”, ma ciò non toglie che, una volta dissipata la nebbia, le tecnologie davvero trasformative possano produrre benefici “giganteschi” per la società.

La letteratura recente distingue tra le cosiddette “good bubbles”, che accelerano l’adozione di nuove tecnologie, e quelle “bad”, alimentate prevalentemente da leva, euforia e finanziarizzazione. La storia offre esempi in entrambe le direzioni: dalle ferrovie all’elettrificazione, molte ondate speculative hanno generato infrastrutture durature pur a fronte di crolli dolorosi; altre, come la bolla immobiliare pre-2008, hanno prodotto soprattutto danni. La verità è che crescita, eccessi e dispersione dei rendimenti tendono a coesistere. Il dibattito sull’IA riflette questa ambivalenza. Se da un lato la scala degli investimenti attuali è senza precedenti, dall’altro emergono domande sulla sostenibilità del modello, soprattutto per operatori non profittevoli. La recente discussione intorno alla richiesta, poi ridimensionata, di OpenAI di esplorare garanzie federali per la costruzione di nuovi impianti di chip ne è un esempio. Il tema ha attirato critiche immediate: in un ecosistema alimentato da capitali privati e valutazioni da centinaia di miliardi, la possibilità di un sostegno pubblico è apparsa a molti come un rischio di “backstop implicito” per progetti industriali ad altissima intensità di capitale. Altman ha chiarito che l’azienda non cerca un salvataggio e che “se sbagliamo, dobbiamo fallire”, ma il fatto stesso che la questione sia stata discussa mostra la tensione crescente tra ambizione tecnologica e vincoli finanziari.

Allo stesso tempo, è impossibile ignorare il ruolo, sempre più esplicito, dei governi. Negli Stati Uniti, la Genesis Mission firmata dalla Casa Bianca pochi giorni fa mette l’IA al centro della competizione tecnologica globale, con un’impostazione che richiama la logica dei grandi programmi strategici del passato (il programma Apollo o il progetto Manhattan per esempio). Il messaggio è chiaro: l’IA non è più solo un tema di mercato, ma un’infrastruttura critica per sicurezza nazionale, produttività e leadership industriale. Per le imprese significa che l’allocazione di capitale, le catene di fornitura e gli standard di governance dell’IA si muoveranno in un quadro sempre più influenzato da priorità politiche e geopolitiche.

In definitiva, che l’IA sia o meno una bolla rimane una questione aperta, dipendente da variabili tecnologiche, macroeconomiche e politiche difficili da modellizzare oggi. Ma l’esperienza storica e i segnali attuali convergono su un punto: i cicli dell’innovazione non procedono mai in linea retta. Possono contenere euforia, dispersione, investimenti eccessivi e, allo stesso tempo, produrre progressi reali e strutturali. Come sempre, lasciamo al lettore trarre le conclusioni: distinguere tra trend strutturale e narrativa, tra investimenti necessari ed eccessi, tra segnali di maturità e segnali di debolezza. L’IA sembra destinata a ridefinire interi settori mentre la domanda, per investitori e policy maker, è a quale costo, con quali tempi e con quale equilibrio tra pubblico e privato.

Approfondimento a cura di Nicola Lampis

Lugano, 30 novembre 2025

[1] IPO Returns: Pre And Post Dotcom Bubble, Journal of Business Economics Research November – 2005 Volume 3, Number 11